使用ControlNet的openpose_hand生成指定姿势的人物图片

平时用Stable Diffusion画图,如果是想用提示词来描述一个姿势或动作,动作越复杂功越详细就越难以描述,但如果简单地描述一下比如坐在台阶上或坐在地上,那么可能会有N种坐着以及手势、脚的姿势等。

不过这样也能得到随机变换那就很快乐,抽盲盒的乐趣。本文重点介绍固定人物姿势的方法,通过ControlNet来固定人物姿势,引导AI画出类似姿势的图片,一这程度上还能减少手残的概率。

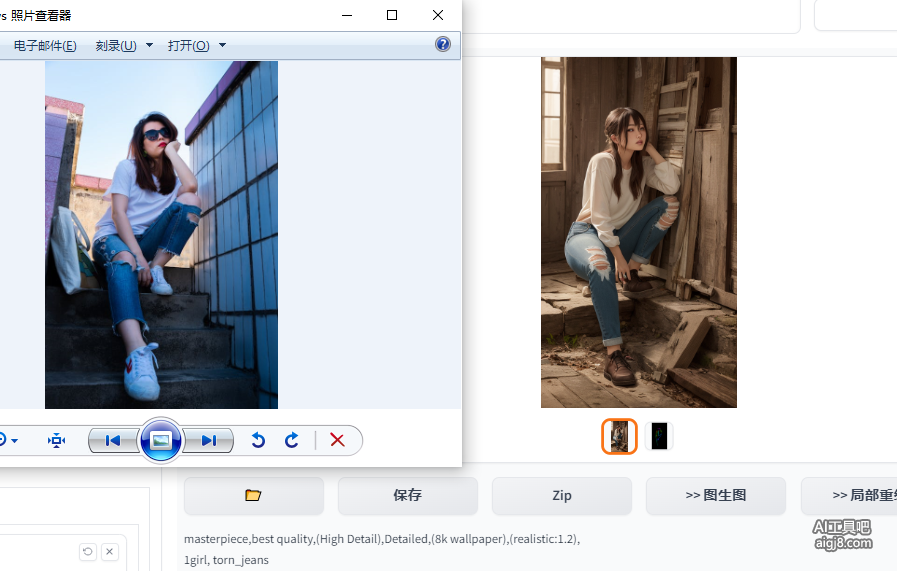

先上效果图如下:

上图效果使用了ControlNet的openpose_hand预处理器,不完全使用反推提示词,这样有利于丰富人物的其它特征。

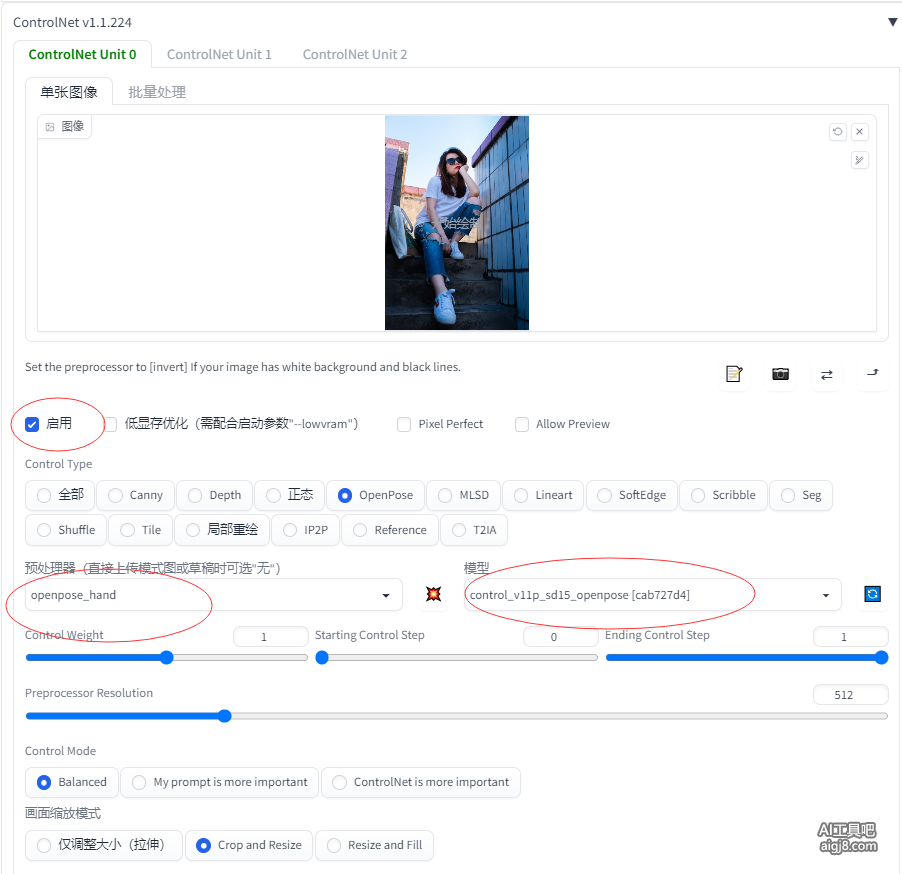

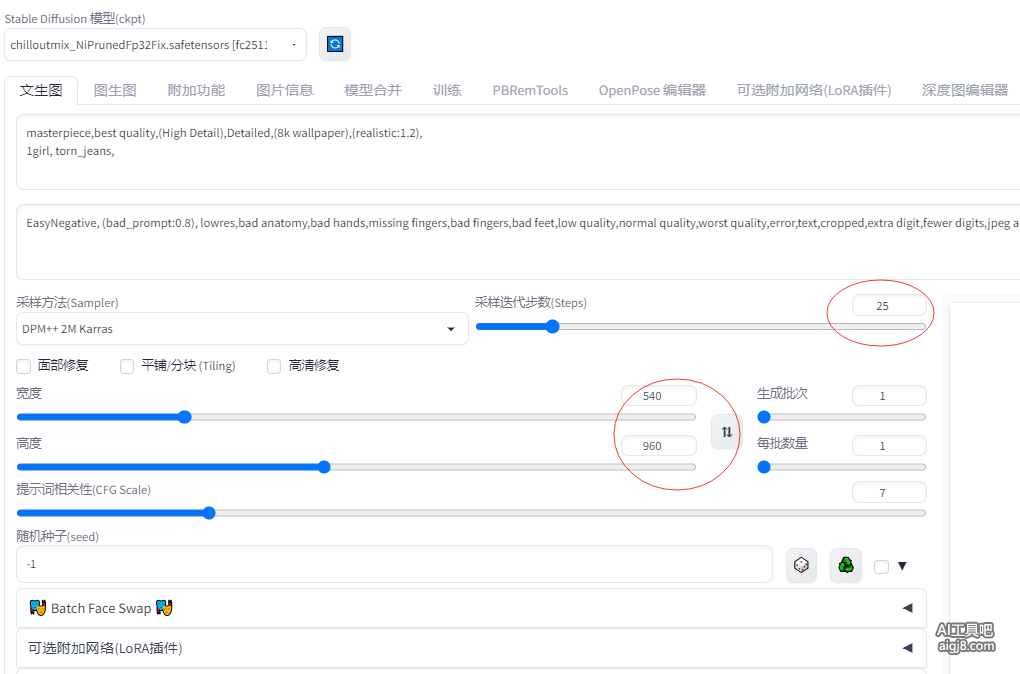

第一步:打开文生图,并选模型chilloutmix_NiPrunedFp32Fix,启用ControlNet并选预处理器为openpose_hand,预处理器模型为control_v11p_sd15_openpose,然后上传原始图片。

第二步:填写文生图的参数,在本次案例中,提示词如下

正向

masterpiece,best quality,(High Detail),Detailed,(8k wallpaper),(realistic:1.2),

1girl, torn_jeans,

负向

EasyNegative, (bad_prompt:0.8), lowres,bad anatomy,bad hands,missing fingers,bad fingers,bad feet,low quality,normal quality,worst quality,error,text,cropped,extra digit,fewer digits,jpeg artifacts,signature,username,blurry,watermark,two face,multiple people,extra fingers, extra feet,nsfw

尺寸选 540*960 ,因为原图是竖图,所以用这个比例来做最佳。迭代步数25。

以上两步即可生成图片,上图的随机种子是 2832377300

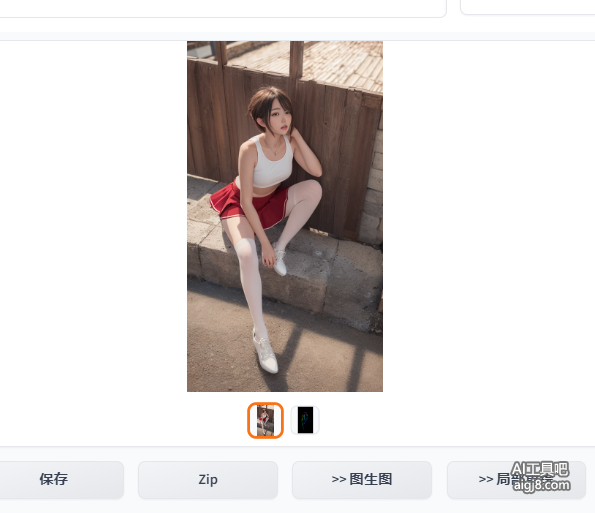

扩展一下,把衣服 发型 换一换,人物姿势不变,启用了面部修复。根据个人感觉,当AI画的是人物全身图,景深比较大,而非人物上半身特写之类的图片,面部偶尔会蹦,启用面部修复能缓解这个情况。

masterpiece,best quality,(High Detail),Detailed,(8k wallpaper),(realistic:1.2),

1girl, ((red short skirt):1.2),(White stockings),(crop top),(short blunt hair)

通过将提示词修改为 一个女孩、红色短裙、白色丝袜、短上衣,短发刘海 。AI在保持姿势的情况下画出了另个服装的人物。

上图seed 3409055239

本文由stable diffusion在线绘画 aigj8.com 分享,转载请注明出处。

本文网址:https://www.aigj8.com/stablediffusion/217.html

相关文章

- 尝鲜stable diffusion真正换脸插件batch face swap,不需要蒙版微调

- stable diffusion 文字嵌入到图像、基于Controlnet光影字

- 实测用chagtGPT生成stable diffusion绘画提示词,效果惊艳

- 两步实现 stable-diffusion-webui 1.7设置切换中文界面

- stable diffusion的reference_adain+attn插件使绘画保持同一个人同一张脸

- 优化使用体验,给stablediffusion-webui模型及lora做分类展示和缩略图预览

- stable diffusion绘制文字的一种方法depth_midas

- 如果不做高清修复放大,Stable Diffusion大多情况下不超过6G显存